7月17日,法國著名開源大模型平臺Mistral.ai在官網開源了,基于Mamba架構的純代碼模型——Codestral Mamba。

根據測試數據顯示,Codestral Mamba只有70億參數,但性能卻是Meta開源的知名代碼模型CodeLlam 7B的兩倍,成為同類最強代碼模型之一。

開源地址:https://huggingface.co/mistralai/mamba-codestral-7B-v0.1

此外,Codestral Mamba支持256k上下文窗口可商業化,其架構使用的是目前比較流程的Mamba。

Mamba架構的核心優勢在于其線性時間推理能力,這意味著能在處理序列數據時,無論序列長度如何增長,推理時間都能保持線性增長,而非指數級的膨脹。

這一點與傳統的Transformer架構形成了鮮明對比,它在處理長序列時,由于自注意力機制的計算復雜度,會面臨計算成本隨序列長度增加而急劇上升的問題。Mamba架構的這一特性使得它在處理大規模數據集和長序列時更加高效,為實時交互和大規模數據處理提供了可能

在計算效率上,Mamba通過改進的注意力機制,減少了處理序列數據所需的計算量。這種機制不僅加快了數據處理速度,而且提高了數據訪問的效率。

Mamba在內存使用上進行了優化,這對于移動設備和邊緣計算等資源受限的場景尤為重要,確保了即使在硬件條件有限的情況下,模型也能順暢運行。

Mamba架構的另一個顯著優勢是其出色的可擴展性,允許模型更容易地擴展到更大的尺寸,而不會犧牲性能。這一點對于那些需要處理更復雜任務和更大模型的應用來說,是一個巨大的吸引力。

所以,Mamba架構不僅能夠加快模型的訓練速度,減少迭代和實驗的時間,還能在推理時提供更低的延遲,這對于需要實時響應的應用場景至關重要。

此外,Mamba架構在保持或提高模型性能的同時,減少了所需的計算資源,這對于中小型企業、個人開發者來說幫助非常大,同時可以在更小的硬件上運行。

Mistral.ai還建議開發者在使用Codestral Mamba時與其之前開源的mistral-inference搭配一起使用效果更好。

mistral-inference開源地址:https://github.com/mistralai/mistral-inference

本文素材來源Mistral.ai官網,如有侵權請聯系刪除

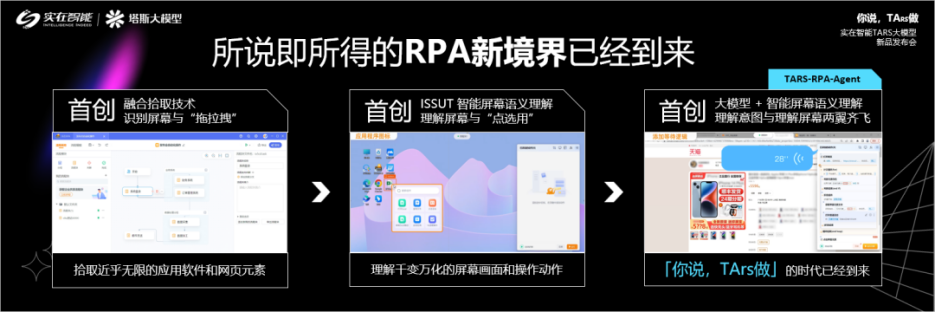

未經允許不得轉載:RPA中國 | RPA全球生態 | 數字化勞動力 | RPA新聞 | 推動中國RPA生態發展 | 流 > 可商用、性能超強!新開源Mamba架構純代碼模型

heng.png)

參賽者必看 | 拯救者杯OPENAIGC開發者大賽最全攻略指南來啦~

參賽者必看 | 拯救者杯OPENAIGC開發者大賽最全攻略指南來啦~ 達觀助手智能寫作產品正式發布,全面提升寫作能力!

達觀助手智能寫作產品正式發布,全面提升寫作能力! 生成式AI為何不完全適用當下B2B行業?

生成式AI為何不完全適用當下B2B行業? Gartner:ChatGPT只是開始,企業生成式AI的未來

Gartner:ChatGPT只是開始,企業生成式AI的未來

熱門信息

閱讀 (15088)

1 2023第三屆中國RPA+AI開發者大賽圓滿收官&獲獎名單公示閱讀 (14227)

2 《Market Insight:中國RPA市場發展洞察(2022)》報告正式發布 | RPA中國閱讀 (13147)

3 「RPA中國杯 · 第五屆RPA極客挑戰賽」成功舉辦及獲獎名單公示閱讀 (13054)

4 與科技共贏,與產業共進,第四屆ISIG中國產業智能大會成功召開閱讀 (11885)

5 《2022年中國流程挖掘行業研究報告》正式發布 | RPA中國