英國時間11月1日,中國、美國、英國、法國、德國等28個國家和歐盟,在英國的布萊切利莊園簽署了,首個全球性人工智能(AI)聲明——《布萊切利宣言》。

該宣言明確指出了AI對人類社會的巨大機遇,但AI需要以人為本、可信賴、負責任的方式設計和使用造福全人類。

特別指出了“前沿”AI可能帶來的風險,例如,ChatGPT、Bard、Midjourney等大語言模型以及其他“超”能力的狹義AI。這類系統的能力難以預測,可能被誤用或失控。

所以,呼吁國際社會通力合作,在現有的國際論壇下制定政策和法規來提升透明度、問責制,并加強對這類前沿AI的科學研究與風險評估,以安全、健康、可靠的方式發展和應用AI。

宣言地址:https://www.gov.uk/government/publications/ai-safety-summit-2023-the-bletchley-declaration/the-bletchley-declaration-by-countries-attending-the-ai-safety-summit-1-2-november-2023

中國科技部副部長-吳朝暉率團出席此次峰會,參與AI安全等問題討論,積極宣介中方提出的《全球AI治理倡議》,并將與相關國家開展雙邊會談。

中國科技部副部長吳朝暉

此外,中國科學院、微軟、騰訊、阿里巴巴、馬斯克、OpenAI首席執行官Sam Altman、谷歌DeepMind首席執行官Demis Hassabis等科技界知名人士出席了會議。

以下是《布萊切利宣言》內容

AI為全球帶來巨大機遇:能改造和提升人類福祉、和平與繁榮。為了實現這一目標,我們堅定認為,為了全人類福祉,AI的設計、開發、部署和使用都應該以安全、以人為本、可信賴和負責任的方式進行。

歡迎國際社會迄今為止在AI領域的合作努力,以促進包容性經濟增長、可持續發展和創新,保護人權和基本自由,并增強公眾對AI系統的信任和信心,以充分發揮其潛力。

AI系統已經被部署到日常生活的許多領域,包括住房、就業、交通、教育、健康、無障礙環境和司法等,且其使用還在不斷增加。我們認識到,這是一個采取行動的關鍵時刻,需要確保AI的安全發展,以及AI的轉型性機遇惠及所有人,包容地應用于我們各國以及全球。

這包括公共服務領域如健康和教育,糧食安全,科學,清潔能源,生物多樣性和氣候等,以實現人權保障,并加強實現聯合國可持續發展目標的努力。與這些機遇同時,AI也帶來重大風險,包括日常生活領域的風險。

為此,我們歡迎相關國際力量通過現有論壇和其他相關倡議,審視和應對AI系統潛在影響的努力,以及對保護人權、透明度和解釋性、公平性、問責制、監管、安全性、適當的人類監督、倫理、偏見緩解、隱私和數據保護等問題的重視。我們還注意到操縱內容或生成誤導內容的能力可能帶來難以預見的風險。所有這些問題都至關重要,我們堅定需要并迫切地解決這些問題。

在AI的“前沿”領域存在特定的安全風險,這些前沿領域是指那些高度能力的通用AI模型,包括基礎模型,可以執行各種各樣的任務,以及可能展示出可能造成傷害的能力的相關特定狹義AI,其能力匹配或超過了當今最先進模型所具有的能力。

這些AI模型的重大能力可能會由于潛在的故意濫用或與人類意圖不一致所導致的無意中的控制問題而產生實質性風險。

由于這些能力并不為人完全理解,因此很難預測,這也是導致上述問題的部分原因。我們特別關注此類風險可能出現在網絡安全、生物技術等領域,以及前沿AI系統可能會放大錯誤信息等其他風險。

馬斯克談AI影響

這些AI模型最強大的能力,無論是故意還是無意,都存在造成嚴重甚至災難性傷害的可能。鑒于AI變化迅速且難以預測,以及技術投資正在加速,我們堅信,深入理解這些潛在風險以及解決這些風險的行動尤為緊迫。

許多AI風險本質上具有國際性,因此最好通過國際合作來解決。我們決心以包容的方式共同努力,通過現有的國際論壇和其他相關倡議,確保以人為本、可信賴和負責任的安全AI,造福所有人。我們將促進合作,以應對AI帶來的廣泛風險。

在此過程中,我們認識到,各國應考慮采取有利于創新和適度治理與監管的方法,以最大限度發揮AI的效益,并考慮其相關風險。這可能包括在適當情況下,根據國情和適用的法律框架,對風險進行分類和歸類。

我們還注意到,在適當情況下,合作開發共同原則和行為守則等方法的相關性。關于前沿AI相關的具體風險,我們決心加強和持續我們的合作,并與更多國家 擴大合作,通過現有的國際論壇和其他相關倡議,識別、理解這些風險,并在適當情況下采取行動,包括未來的國際AI安全峰會。

所有行為體在確保AI安全方面都有角色發揮:各國、國際論壇和其他倡議、企業、公民社會和學術界需要共同努力。我們注意到包容性AI和彌合數字鴻溝的重要性,重申國際合作應努力吸引和邀請廣泛的合作伙伴參與,我們歡迎那些有助于發展中國家加強AI能力建設、發揮AI的支持作用以促進可持續增長和彌合發展差距的面向發展的方法和政策。

我們堅信,盡管必須全生命周期考慮安全性,但開發前沿AI能力的行為體,特別是開發異常強大、潛在有害的AI系統的行為體,有非常重要的責任來確保這些系統的安全,包括通過安全測試系統、評估等適當措施。

鼓勵所有相關行為體根據上下文提供透明度和問責制,對其計劃測量、監控和緩解可能的有害能力及相關后果的計劃提供透明度和問責制,特別是為了防止誤用和控制問題以及放大其他風險。

在我們合作的背景下,為了指導國家和國際層面的行動,我們關于應對前沿AI風險的議程將聚焦于:

識別共同關注的AI安全風險,建立共享的科學和基于證據的這些風險理解,并隨著能力的不斷提高而持續這種理解,在更廣泛的全球方法來理解AI對我們社會的影響的背景下。

在各國構建基于風險的政策,根據這些風險確保安全,在適當情況下開展協作,同時認識到我們的方法可能基于國情和適用的法律框架而有所不同。

這包括私營部門開發前沿AI能力的行為體提高透明度以外,還包括適當的評估指標、安全測試工具,以及開發相關的公共部門能力建設和科學研究。

為推進這一議程,我們決心支持一個國際包容的前沿AI安全科學研究網絡,其涵蓋并補充現有和新的多邊、小集團和雙邊合作,包括通過現有的國際論壇和其他相關倡議,以便為政策制定和公共利益提供最佳的科學依據。

鑒于AI巨大的正面轉型潛力,并作為確保AI更廣泛國際合作的一部分,我們決心維持一個包容的全球對話,吸引現有國際論壇和其他相關倡議,并以開放的方式對更廣泛的國際討論做出貢獻;我們將繼續開展前沿AI安全研究,以確保這項技術的利益可以被負責任地造福全人類。

出席的國家:

-

中國 -

澳大利亞 -

巴西 -

加拿大 -

智利 -

歐洲聯盟 -

法國 -

德國 -

印度 -

印度尼西亞 -

愛爾蘭 -

以色列 -

意大利 -

日本 -

肯尼亞 -

沙特阿拉伯王國 -

荷蘭 -

尼日利亞 -

菲律賓人 -

大韓民國 -

盧旺達 -

新加坡 -

西班牙 -

瑞士 -

土耳其 -

烏克蘭 -

阿拉伯聯合酋長國 -

大不列顛及北愛爾蘭聯合王國 -

美國

本文素材來源英國國家官網,如有侵權請聯系刪除

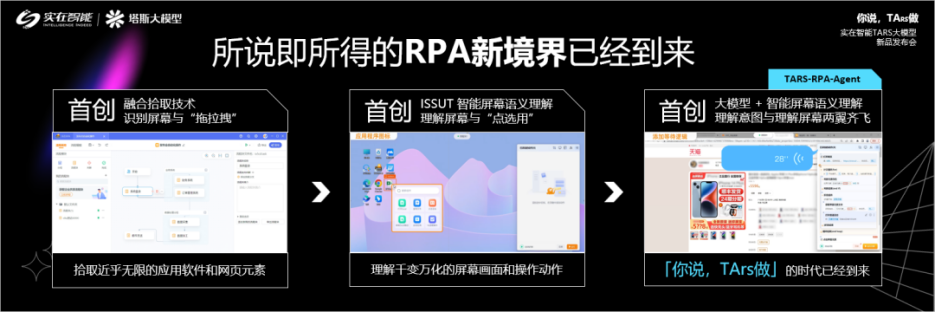

未經允許不得轉載:RPA中國 | RPA全球生態 | 數字化勞動力 | RPA新聞 | 推動中國RPA生態發展 | 流 > 中國等28個國家發布《布萊切利宣言》,鼓勵AI以安全方式發展

heng.png)

達觀助手智能寫作產品正式發布,全面提升寫作能力!

達觀助手智能寫作產品正式發布,全面提升寫作能力! 生成式AI為何不完全適用當下B2B行業?

生成式AI為何不完全適用當下B2B行業? Gartner:ChatGPT只是開始,企業生成式AI的未來

Gartner:ChatGPT只是開始,企業生成式AI的未來 ?中國何時能有ChatGPT?“現象級”產品背后的AI技術發展與展望

?中國何時能有ChatGPT?“現象級”產品背后的AI技術發展與展望

熱門信息

閱讀 (14728)

1 2023第三屆中國RPA+AI開發者大賽圓滿收官&獲獎名單公示閱讀 (13753)

2 《Market Insight:中國RPA市場發展洞察(2022)》報告正式發布 | RPA中國閱讀 (13055)

3 「RPA中國杯 · 第五屆RPA極客挑戰賽」成功舉辦及獲獎名單公示閱讀 (12964)

4 與科技共贏,與產業共進,第四屆ISIG中國產業智能大會成功召開閱讀 (11567)

5 《2022年中國流程挖掘行業研究報告》正式發布 | RPA中國