人工智能的力量正在改變世界各行各業,如醫療保健、金融、零售、公共部門和互聯網等。但是,隱私問題是人工智能亟待解決的挑戰,尤其是在涉及合規性和法規方面。2017年,英國醫療服務體系(NHS)醫院未經英國國家衛生局的同意,向 Alphabet(谷歌母公司)的DeepMind提供了160萬患者數據。這些數據主要用于開發和完善一個智能診斷和檢測系統,可以發現患者是否正處于急性腎損傷的風險中。但此新聞被曝光后,在英國各界引起了極大地反響,患者們紛紛譴責谷歌這種“盜竊”行為。

另外,包括蘋果、谷歌和亞馬遜在內的科技巨頭,在AI隱私方面也受到了廣泛關注,他們可能正在濫用錄音來改善Siri和Google Assistant等人工智能助手。

AI系統的脆弱性

在大多數AI系統的核心處,由神經網絡組成,而神經網絡則由神經元組成。這些功能按層排列,然后將信號傳輸到其他神經元。這些信號從一層到另一層傳播,并緩慢地“調整”網絡,實際上是在調整每個連接點的權重。隨著時間的推移,神經網絡從數據集中提取特征并識別交叉樣本趨勢并最終學會數據預測。

神經網絡不會攝取原始圖像、視頻、音頻或文本。而是將訓練語料庫的樣本數據轉換為多維數組,例如標量(單個數字),向量(標量的有序數組)和矩陣(標量排列成一列或多列和一列或多行)。盡管進行了轉換,但通常仍可以從神經網絡的輸出中識別出潛在的敏感數據。數據集本身也容易受到攻擊,因為它們通常不會被混淆,并且它們通常存儲在易于受到數據泄露的集中式存儲庫中。

到目前為止,機器學習中最常見的攻擊為“隸屬推理攻擊”,其中攻擊者(使用單個數據點或多個數據點)確定其是否屬于訓練目標模型的語料庫。事實證明,從數據集中刪除敏感信息并不意味著無法重新推斷它,因為AI非常擅長重建數據樣本。除非使用隱私保護技術,否則受過訓練的模型很容易將數據泄露出去。

在一項研究中,威斯康星大學和馬什菲爾德診所研究基金會的研究人員,可以從經過訓練可預測藥物劑量的機器學習模型中提取患者的基因信息。在另一項研究中,卡內基·梅隆大學和威斯康星大學的研究科學家從多個面部識別模型中,重建了特定的頭部圖像。

與科技進步相比,數據隱私成為了用戶更關心的問題。在美國的50個州和哥倫比亞特區,數百項涉及隱私,網絡安全和數據泄露的法案正在等待立案或已經通過。其中最全面的是《加州消費者隱私法》,大約在兩年前簽署成為法律。其他的包括《健康數據可移植性和責任制法案》(HIPAA),該法案要求科技公司在披露個人健康信息之前必須尋求授權。歐盟的《通用隱私數據保護條例》(GDPR)等國際框架旨在更好地控制企業在數據方面的收集和使用。所以,在新興技術中企業越來越關注用戶的隱私問題,聯合學習、差別隱私、同態加密這3項技術對于用戶的數據起到了很好的保護作用。

1、聯合學習

聯合學習是一種在不交換數據樣本的分散設備或服務器上訓練AI算法的技術。先使用用戶的設備下載當前的模型,然后用設備的數據訓練這個模型,之后所有的改變都會總結為一個小的更新。最后,只有這個更新會被傳到云端(使用加密通信的方式),并與其他用戶的更新合在一起平均化,然后改善共享模型。所有的訓練數據都保留在用戶的設備上,云端不會存儲單獨的數據。目前,Google已將聯合學習用于Gboard預測鍵盤中的個性化設置,用在成千上萬的iOS和Android設備中。在Pixel4推出的同時,Google推出了“即時播放”音樂識別功能的改進版本,該功能以聯合方式匯總歌曲的播放次數,根據不同地區來確定最受歡迎的歌曲以提高識別度。

2、差別隱私

差別隱私是密碼學中的一種保護系統,旨在提供一種從統計數據庫查詢時,最大化數據查詢的準確性,同時最大限度減少識別其記錄的機會。當年蘋果在發布“iOS 10”系統時便著重介紹了差別隱私這項技術。蘋果通過使用差別隱私技術,使系統在不影響個人隱私的前提下,幫助發現大批量用戶的使用模式。為了掩蓋個人身份,差別隱私會像個人使用模式的小樣本中加入數學噪音。隨著更多的用戶呈現出相同的模式,總體模式就會開始顯現,這可以用來保護用戶敏感數據。

差別隱私是統計和數據分析領域中的研究主題,利用哈希、分段抽樣和噪聲注入等方法,在實現眾包學習時也完全保護了用戶的個人隱私。蘋果在這個技術方面做了很多非常重要的努力,來確保其可以進行大規模的應用。根據蘋果的說法,差別隱私是一個統計學的概念,在試圖更多分析了解一個群組信息整體趨勢的同時,可以盡可能少的了解這個群組中的個體詳情。利用差別隱私,蘋果可以收集和存儲其用戶數據,并從中總結出用戶們在做什么、喜歡什么、想要什么等,但同時又不會提取到有關該群體中任何可能會侵犯隱私的個人信息。并且在理論上,黑客或者情報機構也不可能提取到這些個體信息。

同態加密并不是一項新鮮技術,早在2009年IBM研究員CraigGentry開發了第一個同態加密的保護機制。同態加密是一項基于數學難題的計算復雜性理論的密碼學技術。對經過同態加密的數據進行處理得到一個輸出,將這一輸出進行解密,其結果與用同一方法處理未加密的原始數據得到的輸出結果是一樣的。同態加密技術最優秀的地方在于,其關注的是數據處理安全。同態加密提供了一種對加密數據進行處理的功能。也就是說,其他人可以對加密數據進行處理,但是處理過程不會泄露任何原始內容;同時,擁有密鑰的用戶對處理過的數據進行解密后,得到將是處理后的結果。

在應用方面,IBM高級研究科學家Flavio Bergamaschi及其團隊與一家美國銀行進行合作,使用同態加密技術對機器學習處理流程進行加密。該機器學習處理流程是一個線性回歸模型,擁有超過12個變量,它分析了來自賬戶持有人24個月的交易數據,以預測這些賬戶的財務狀況,部分是推薦貸款等產品。由于客戶的隱私和合規性問題,IBM團隊對現有模型和有問題的交易數據進行了加密,并且他們使用加密和未加密的模型進行預測以比較性能。盡管前者的運行速度比后者慢,但準確性卻是相同的。

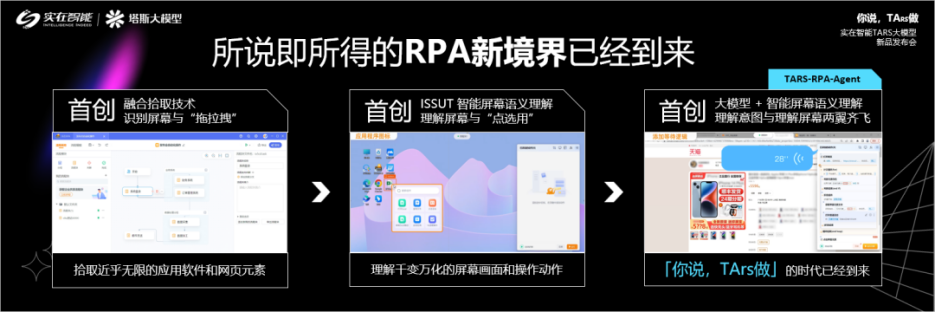

未經允許不得轉載:RPA中國 | RPA全球生態 | 數字化勞動力 | RPA新聞 | 推動中國RPA生態發展 | 流 > AI存在隱私問題,但這3項技術可以輕松解決

heng.png)

達觀助手智能寫作產品正式發布,全面提升寫作能力!

達觀助手智能寫作產品正式發布,全面提升寫作能力! 生成式AI為何不完全適用當下B2B行業?

生成式AI為何不完全適用當下B2B行業? Gartner:ChatGPT只是開始,企業生成式AI的未來

Gartner:ChatGPT只是開始,企業生成式AI的未來 ?中國何時能有ChatGPT?“現象級”產品背后的AI技術發展與展望

?中國何時能有ChatGPT?“現象級”產品背后的AI技術發展與展望

熱門信息

閱讀 (14728)

1 2023第三屆中國RPA+AI開發者大賽圓滿收官&獲獎名單公示閱讀 (13753)

2 《Market Insight:中國RPA市場發展洞察(2022)》報告正式發布 | RPA中國閱讀 (13055)

3 「RPA中國杯 · 第五屆RPA極客挑戰賽」成功舉辦及獲獎名單公示閱讀 (12964)

4 與科技共贏,與產業共進,第四屆ISIG中國產業智能大會成功召開閱讀 (11567)

5 《2022年中國流程挖掘行業研究報告》正式發布 | RPA中國