前不久,獲得亞馬遜40億美元投資的ChatGPT主要競(jìng)爭(zhēng)對(duì)手Anthropic在官網(wǎng)公布了一篇名為《朝向單義性:通過(guò)詞典學(xué)習(xí)分解語(yǔ)言模型》的論文,公布了解釋經(jīng)網(wǎng)絡(luò)行為的方法。

由于神經(jīng)網(wǎng)絡(luò)是基于海量數(shù)據(jù)訓(xùn)練而成,其開(kāi)發(fā)的AI模型可以生成文本、圖片、視頻等一系列內(nèi)容。雖然一些數(shù)學(xué)題、推理我們可以看到正確結(jié)果,例如,AI模型會(huì)告訴你1+1=2這個(gè)結(jié)果,卻無(wú)法解釋這個(gè)過(guò)程是如何產(chǎn)生的。即便進(jìn)行簡(jiǎn)單解釋?zhuān)仓皇腔谡Z(yǔ)義上的理解。

就像人類(lèi)做夢(mèng)一樣,可以說(shuō)出做夢(mèng)的內(nèi)容,卻無(wú)法解釋夢(mèng)境到底是怎么形成的。

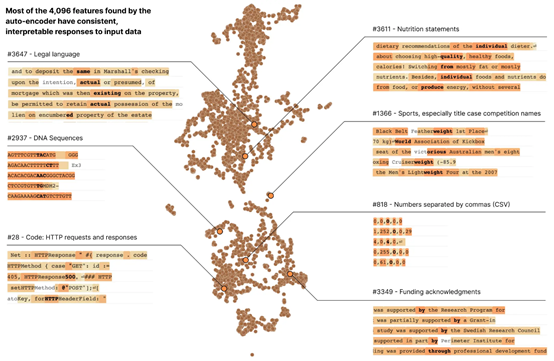

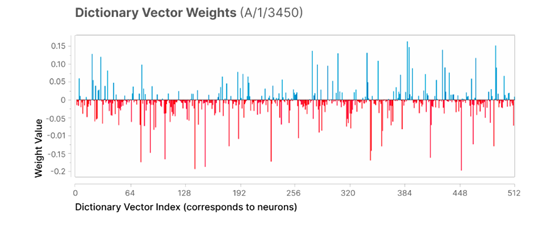

Anthropic根據(jù)Transformer模型進(jìn)行了一個(gè)小型實(shí)驗(yàn),將512個(gè)神經(jīng)單元分解成4000多個(gè)特征,分別代表 DNA 序列、法律語(yǔ)言、HTTP 請(qǐng)求、營(yíng)養(yǎng)說(shuō)明等。研究發(fā)現(xiàn),單個(gè)特征的行為比神經(jīng)元行為更容易解釋、可控,同時(shí)每個(gè)特征在不同的AI模型中基本上都是通用的。

ChatGPT等大語(yǔ)言模型經(jīng)常出現(xiàn)幻覺(jué)、歧視、虛假等信息的情況,主要是人類(lèi)無(wú)法控制其神經(jīng)網(wǎng)絡(luò)行為。所以,該研究對(duì)于增強(qiáng)大語(yǔ)言模型的準(zhǔn)確率、安全性,降低非法內(nèi)容輸出幫助非常大。

論文地址:https://transformer-circuits.pub/2023/monosemantic-features/index.html#phenomenology-feature-splitting

為了更好地理解Anthropic的研究,「AIGC開(kāi)放社區(qū)」先為大家簡(jiǎn)單解讀幾個(gè)技術(shù)概念。

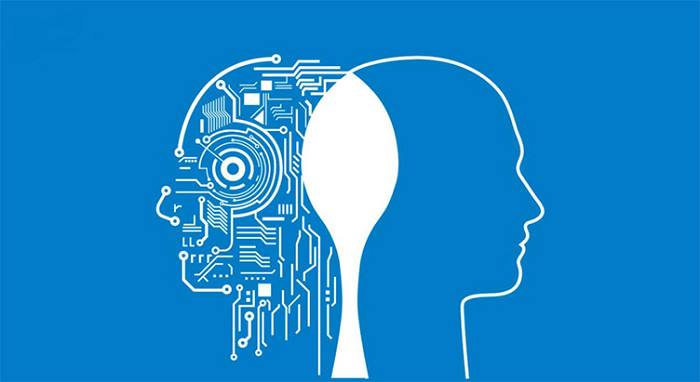

什么是神經(jīng)網(wǎng)絡(luò)

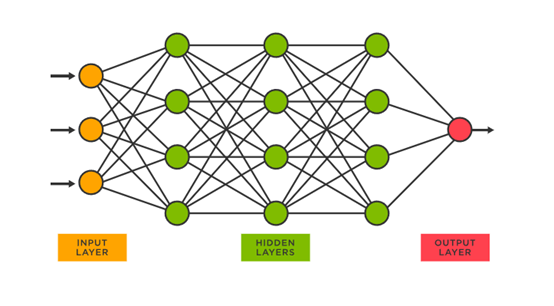

神經(jīng)網(wǎng)絡(luò)是一種模仿人腦神經(jīng)元結(jié)構(gòu)的計(jì)算模型,用于解決各種復(fù)雜的計(jì)算問(wèn)題,主要用于模式識(shí)別、數(shù)據(jù)挖掘、圖像識(shí)別、自然語(yǔ)言處理等領(lǐng)域。

神經(jīng)網(wǎng)絡(luò)的核心組成部分是神經(jīng)元,它們通過(guò)一系列的權(quán)重連接在一起,形成一個(gè)大型網(wǎng)絡(luò)結(jié)構(gòu)。

主要包括3個(gè)層:1)輸入層,用于接收原始數(shù)據(jù),并將其傳遞給網(wǎng)絡(luò)的下一層;2)隱藏層,是網(wǎng)絡(luò)中的核心部分,包含了一系列神經(jīng)元用于處理輸入數(shù)據(jù)并產(chǎn)生輸出;3)輸出層,將隱藏層的結(jié)果匯總并產(chǎn)生最終的輸出。

簡(jiǎn)單來(lái)說(shuō),神經(jīng)網(wǎng)絡(luò)就是模仿人類(lèi)的大腦思維與思考、解讀問(wèn)題。神經(jīng)元就相當(dāng)于人腦中的放電神經(jīng)元。

經(jīng)過(guò)幾十年的研究,科學(xué)家們可以大概了解人腦神經(jīng)元的運(yùn)行規(guī)律,但仍然有很多謎團(tuán)無(wú)法解開(kāi),例如,大腦是如何產(chǎn)生情感、夢(mèng)境、獨(dú)立思想等。所以,想深度解釋神經(jīng)網(wǎng)絡(luò)的工作原理同樣不容易。

什么是神經(jīng)元

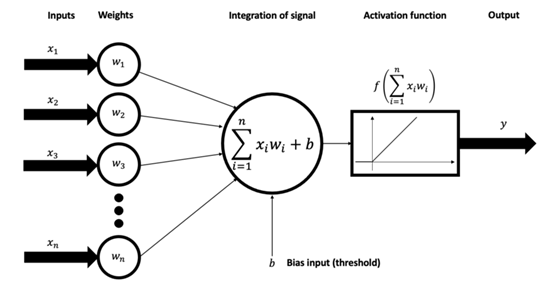

神經(jīng)元是神經(jīng)網(wǎng)絡(luò)的基本組成部分,主要對(duì)數(shù)據(jù)進(jìn)行輸入、計(jì)算和輸出。

神經(jīng)單元的工作原理模擬了人腦中神經(jīng)元的工作方式,接收一個(gè)或多個(gè)輸入,每個(gè)輸入都有一個(gè)對(duì)應(yīng)的權(quán)重。這些輸入和權(quán)重的乘積被加總,然后加上一個(gè)偏置項(xiàng)。得到的總和被送入一個(gè)激活函數(shù),激活函數(shù)的輸出就是這個(gè)神經(jīng)單元的輸出。

在神經(jīng)網(wǎng)絡(luò)的訓(xùn)練過(guò)程中,網(wǎng)絡(luò)會(huì)不斷調(diào)整這些權(quán)重和偏置項(xiàng),以便更好地預(yù)測(cè)或分類(lèi)輸入數(shù)據(jù)。

這個(gè)調(diào)整過(guò)程通常通過(guò)一種叫做“反向傳播的算法”來(lái)完成,配合梯度下降或其他優(yōu)化方法來(lái)最小化預(yù)測(cè)錯(cuò)誤。 神經(jīng)單元有很多種,包括線(xiàn)性單元、sigmoid單元、ReLU單元等,區(qū)別在于使用的激活函數(shù)不同。

Anthropic研究簡(jiǎn)單介紹

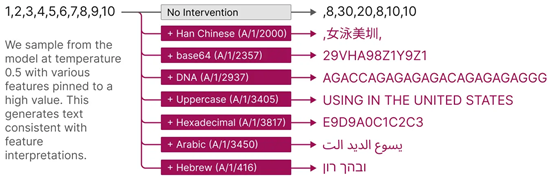

為了解釋神經(jīng)網(wǎng)路行為,Anthropic基于Transformer模型將512個(gè)神經(jīng)元分解成4000多個(gè)特征。這些特征分別代表DNA 序列、法律語(yǔ)言、HTTP 請(qǐng)求、希伯來(lái)語(yǔ)文本、營(yíng)養(yǎng)聲明等,然后進(jìn)行一系列行為操作觀察。

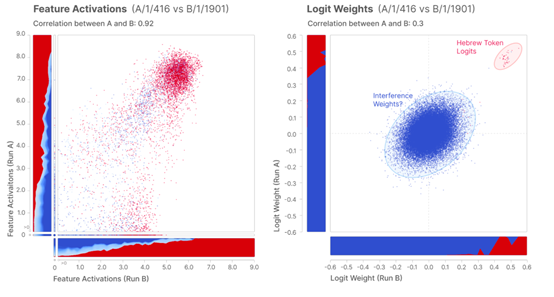

研究結(jié)果表明,單個(gè)特征的行為比神經(jīng)元行為更容易解釋、可控,同時(shí)每個(gè)特征在不同的AI模型中基本上都是通用的。

為了驗(yàn)證其研究,Anthropic創(chuàng)建了一個(gè)盲評(píng)系統(tǒng),來(lái)比較單個(gè)特征和神經(jīng)元的可解釋性。特征(紅色)的可解釋性得分遠(yuǎn)高于神經(jīng)元(藍(lán)綠色)。

Anthropic還采用“自動(dòng)解釋性”方法,使用大型語(yǔ)言模型生成小模型特征的簡(jiǎn)短描述,根據(jù)另一個(gè)模型的描述預(yù)測(cè)特征激活的能力對(duì)其進(jìn)行評(píng)分。

同樣,特征的得分高于神經(jīng)元,這表明特征的激活及其對(duì)模型行為的下游影響具有一致的解釋。

此外,還提供了有針對(duì)性的模型引導(dǎo)方式。人為激活某個(gè)功能,會(huì)導(dǎo)致模型行為以可預(yù)測(cè)的方式發(fā)生變化。

神經(jīng)網(wǎng)絡(luò)對(duì)大語(yǔ)言模型的重要性

神經(jīng)網(wǎng)絡(luò)是大語(yǔ)言模型的重要基石,例如,OpenAI的GPT系列模型是基于Transformer的神經(jīng)網(wǎng)絡(luò)架構(gòu)開(kāi)發(fā)而成。

大語(yǔ)言模型使用神經(jīng)網(wǎng)絡(luò)來(lái)處理和生成文本。在訓(xùn)練過(guò)程中,這些模型會(huì)學(xué)習(xí)如何預(yù)測(cè)文本序列中的下一個(gè)詞,或者給定一部分文本后續(xù)的可能內(nèi)容。

為了做到這一點(diǎn),模型需要理解語(yǔ)言的語(yǔ)法、語(yǔ)義、以及在一定程度上的上下文。簡(jiǎn)單來(lái)說(shuō),神經(jīng)網(wǎng)絡(luò)提供了處理和生成自然語(yǔ)言的計(jì)算框架,而大語(yǔ)言模型則通過(guò)這個(gè)框架來(lái)理解和生成文本。

所以,理解神經(jīng)網(wǎng)絡(luò)行為,對(duì)增強(qiáng)大語(yǔ)言模型的安全性、準(zhǔn)確性至關(guān)重要。

本文素材來(lái)源Anthropic官網(wǎng)、論文,如有侵權(quán)請(qǐng)聯(lián)系刪除

未經(jīng)允許不得轉(zhuǎn)載:RPA中國(guó) | RPA全球生態(tài) | 數(shù)字化勞動(dòng)力 | RPA新聞 | 推動(dòng)中國(guó)RPA生態(tài)發(fā)展 | 流 > 大語(yǔ)言模型迎來(lái)重大突破!找到解釋神經(jīng)網(wǎng)絡(luò)行為方法

heng.png)

達(dá)觀助手智能寫(xiě)作產(chǎn)品正式發(fā)布,全面提升寫(xiě)作能力!

達(dá)觀助手智能寫(xiě)作產(chǎn)品正式發(fā)布,全面提升寫(xiě)作能力! 生成式AI為何不完全適用當(dāng)下B2B行業(yè)?

生成式AI為何不完全適用當(dāng)下B2B行業(yè)? Gartner:ChatGPT只是開(kāi)始,企業(yè)生成式AI的未來(lái)

Gartner:ChatGPT只是開(kāi)始,企業(yè)生成式AI的未來(lái) ?中國(guó)何時(shí)能有ChatGPT?“現(xiàn)象級(jí)”產(chǎn)品背后的AI技術(shù)發(fā)展與展望

?中國(guó)何時(shí)能有ChatGPT?“現(xiàn)象級(jí)”產(chǎn)品背后的AI技術(shù)發(fā)展與展望

熱門(mén)信息

閱讀 (14728)

1 2023第三屆中國(guó)RPA+AI開(kāi)發(fā)者大賽圓滿(mǎn)收官&獲獎(jiǎng)名單公示閱讀 (13753)

2 《Market Insight:中國(guó)RPA市場(chǎng)發(fā)展洞察(2022)》報(bào)告正式發(fā)布 | RPA中國(guó)閱讀 (13055)

3 「RPA中國(guó)杯 · 第五屆RPA極客挑戰(zhàn)賽」成功舉辦及獲獎(jiǎng)名單公示閱讀 (12964)

4 與科技共贏,與產(chǎn)業(yè)共進(jìn),第四屆ISIG中國(guó)產(chǎn)業(yè)智能大會(huì)成功召開(kāi)閱讀 (11567)

5 《2022年中國(guó)流程挖掘行業(yè)研究報(bào)告》正式發(fā)布 | RPA中國(guó)